使用Dify搭建MCP服务器完整指南

引言

随着人工智能技术的快速发展,大语言模型(LLM)应用已经成为各行各业提升效率和创新的重要工具。在这个背景下,将AI应用开发平台与模型上下文协议(Model Context Protocol,MCP)相结合,可以创建更加强大、灵活的AI应用生态系统。本指南将详细介绍如何使用Dify(一个开源的LLM应用开发平台)搭建MCP服务器,使您能够将Dify应用无缝集成到支持MCP协议的AI客户端(如Claude Desktop、Cursor等)中。

背景知识

什么是Dify?

Dify是一款开源的大语言模型(LLM)应用开发平台。它融合了后端即服务(Backend as Service)和LLMOps的理念,使开发者可以快速搭建生产级的生成式AI应用。即使是非技术人员,也能参与到AI应用的定义和数据运营过程中。

Dify内置了构建LLM应用所需的关键技术栈,包括:

- 对数百个模型的支持

- 直观的Prompt编排界面

- 高质量的RAG引擎

- 稳健的Agent框架

- 灵活的流程编排

- 易用的界面和API

这些特性使开发者能够专注于创新和业务需求,而不必重复造轮子。

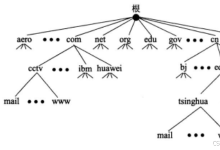

什么是MCP服务器?

Model Context Protocol (MCP) 是由Anthropic主导并于2024年开源的一种通信协议,旨在解决大型语言模型(LLM)与外部数据源及工具之间无缝集成的需求。MCP服务器是实现这一协议的服务端组件,它允许AI模型安全地与本地和远程资源进行交互。

MCP采用客户端-服务器架构:

- MCP客户端(Client):通常是AI应用程序(如Claude Desktop或其他LLM工具),负责发起请求并与服务器通信。

- MCP服务器(Server):轻量级程序,负责暴露特定的数据源或工具功能,并通过标准化协议与客户端交互。

MCP服务器的主要功能包括:

- 资源暴露:提供数据实体(如文件、数据库记录等)给客户端

- 工具提供:暴露可执行功能,让客户端调用完成特定任务

- 动态通知:当资源发生变化时主动推送更新

- 会话管理:处理客户端连接初始化、能力协商和会话关闭

准备工作

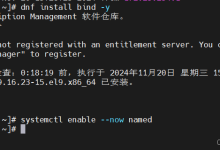

在开始搭建Dify MCP服务器之前,我们需要准备以下环境和工具:

系统要求

- CPU: 至少2核

- RAM: 至少4GB

- 操作系统: Linux(推荐)、macOS或Windows(使用WSL 2)

- Docker和Docker Compose(用于部署Dify)

- Node.js环境(用于运行MCP服务器)

软件依赖

- Docker 19.03或更高版本

- Docker Compose 1.28或更高版本

- Git(用于克隆代码仓库)

- Node.js 14.0或更高版本(对于某些MCP服务器实现)

- Python 3.8或更高版本(对于某些MCP服务器实现)

部署Dify平台

首先,我们需要部署Dify平台作为我们的AI应用开发基础。有两种主要的部署方式:使用Docker Compose或本地源码启动。这里我们使用Docker Compose方式,因为它更简单且适合生产环境。

使用Docker Compose部署Dify

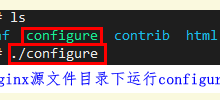

克隆Dify源代码仓库:

git clone https://github.com/langgenius/dify.git –branch 0.15.3

cd dify/docker

复制环境配置文件:

cp .env.example .env

启动Docker容器: 根据您系统上的Docker Compose版本,选择合适的命令启动容器:

对于Docker Compose V2:

docker compose up -d

对于Docker Compose V1:

docker-compose up -d

检查容器运行状态:

docker compose ps

您应该能看到类似以下的输出,显示所有容器都已启动:

[+] Running 11/11

✓ Network docker_ssrf_proxy_network Created

✓ Network docker_default Created

✓ Container docker-redis-1 Started

✓ Container docker-ssrf_proxy-1 Started

✓ Container docker-sandbox-1 Started

✓ Container docker-web-1 Started

✓ Container docker-weaviate-1 Started

✓ Container docker-db-1 Started

✓ Container docker-api-1 Started

✓ Container docker-worker-1 Started

✓ Container docker-nginx-1 Started

访问Dify平台: 在浏览器中打开 http://localhost:3000(或您服务器的IP地址),您应该能看到Dify的登录界面。首次使用时,您需要注册一个账户。

创建应用: 登录后,您可以创建一个新的应用。Dify支持两种类型的应用:

- 对话应用:类似于ChatGPT的交互式对话应用

- 文本生成应用:用于生成特定格式的文本内容

选择适合您需求的应用类型,并完成基本配置。

实现MCP服务器

有两种主要方式可以将Dify与MCP集成:

我们将详细介绍这两种方法。

方法一:使用Dify插件方式

这种方法通过Dify的插件系统,将Dify应用作为MCP服务器暴露给支持MCP协议的AI客户端。

克隆插件仓库:

git clone https://github.com/Yevanchen/difyapp_as_mcp_server.git

cd difyapp_as_mcp_server

将插件文件夹复制到Dify的插件目录:

cp -r ./* /path/to/dify/extensions/

重启Dify服务以加载插件:

cd /path/to/dify/docker

docker compose restart

配置插件: 在Dify管理界面中,找到"插件"部分,启用"difyapp_as_mcp_server"插件,并配置以下参数:

- 应用ID:您想要暴露的Dify应用ID

- 其他设置:根据需要配置

确保您的Dify应用包含至少一个工作流,并且已经正确配置。

方法二:使用独立MCP服务器方式

这种方法使用独立的MCP服务器实现,通过集成Dify API来提供服务。

克隆服务器仓库:

git clone https://github.com/AI-FE/dify-mcp-server.git

cd dify-mcp-server

安装依赖:

npm install

构建服务器:

npm run build

配置Dify API密钥: 在Dify平台上获取API密钥,然后在运行MCP服务器时提供这个密钥。

运行MCP服务器:

DIFY_API_KEY="您的Dify API密钥" node build/index.js

配置AI客户端使用MCP服务器

一旦MCP服务器设置完成,您需要配置AI客户端(如Claude Desktop或Cursor)来使用这个服务器。

配置Claude Desktop

- 对于插件方式:https://您的Dify实例地址/difyapp_as_mcp_server

- 对于独立服务器方式:服务器的访问地址

配置Cursor

- 对于插件方式:https://您的Dify实例地址/difyapp_as_mcp_server

- 对于独立服务器方式:服务器的访问地址

配置Cline(命令行MCP客户端)

如果您使用Cline作为MCP客户端,可以按照以下步骤配置:

创建或编辑~/.continue/config.json文件:

{

"experimental": {

"modelContextProtocolServers": [

{

"transport": {

"type": "stdio",

"command": "node",

"args": ["your/path/dify-server/build/index.js"],

"env": {

"DIFY_API_KEY": "您的Dify API密钥"

}

}

}

]

}

}

或者,创建cline_mcp_settings.json文件:

{

"mcpServers": {

"dify-server": {

"command": "node",

"args": ["your/path/dify-server/build/index.js"],

"env": {

"DIFY_API_KEY": "您的Dify API密钥"

}

}

}

}

使用和测试

一旦配置完成,您可以开始使用和测试您的Dify MCP服务器。

测试MCP服务器连接

使用Dify工具

在支持MCP的AI客户端中,您可以通过自然语言请求使用Dify应用:

调试MCP服务器

如果遇到问题,可以使用以下方法进行调试:

检查MCP服务器日志:

# 对于独立服务器方式

npm run inspector

检查Dify应用日志:

cd /path/to/dify/docker

docker compose logs -f api

常见问题解决

连接问题

- 确保URL正确并可以访问

- 检查是否在防火墙或代理后面

- 验证服务器是否正常运行

工具不可见

- 确保应用ID配置正确

- 检查工作流是否已发布

- 确认Dify API密钥有足够权限

工具执行失败

- 检查Dify应用日志

- 确认工作流在Dify中可以正常运行

- 验证输入参数是否符合要求

高级配置

自定义MCP工具

您可以通过修改Dify工作流来自定义MCP工具的行为:

安全性考虑

在生产环境中部署MCP服务器时,请考虑以下安全措施:

结论

通过本指南,您已经学习了如何使用Dify搭建MCP服务器,将Dify应用无缝集成到支持MCP协议的AI客户端中。这种集成为AI应用开发提供了更大的灵活性和可能性,使您能够充分利用Dify的强大功能和MCP的互操作性。

随着MCP协议的不断发展和完善,我们可以期待更多创新的应用场景和集成方式。希望本指南能够帮助您开始这一令人兴奋的旅程。

参考资源

- Dify官方文档

- Model Context Protocol规范

- difyapp_as_mcp_server插件

- dify-mcp-server独立服务器

- Claude Desktop官方文档

- Cursor编辑器官方网站

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册