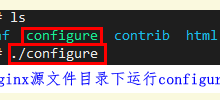

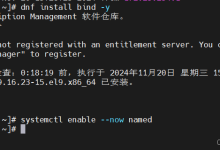

Deepseek这段时间非常火,最新推理模型Deepseek R1,都想装上试一试,特别是部署到服务器教程网上一堆教程好像没几个部署成功靠谱的,先说服务器上下载Ollama就难倒一堆人,每次都超时。今天终于在宝塔看到一篇 应用安装文章,借该方法更简单省事,容器里一次把ollama和open-webui安装了,再科普下Ollama是一个开源框架,专为在本地机器上便捷部署和运行大型语言模型(LLM)而设计。Open WebUI是一款高度可扩展、功能强大且用户友好的自托管Web用户界面,专为完全离线操作设计。DeepSeek-R1系列模型是基于Transformer架构的大型语言模型,支持中英文双语处理。该系列模型通过不断优化算法和增加训练数据,逐步提升了模型的性能和适用性。

如何30秒安装一个DeepSeek-R1 AI模型?今天播播资源全部实操体验成功后分享给大家一起学习。服务器上Ollama+open-webui+DeepSeek-R1系列模型全部搞定

配置不满足运行模型会导致服务器卡死或无法访问,请正确选择服务器配置后部署!

各模型建议的服务器配置: 2c4g可以运行1.5b,想要更流畅的话建议到8g内存,此模型可以不需要GPU 8c16g可以运行7b/8b,此模型建议使用GPU运行,建议最少使用8G运存的GPU

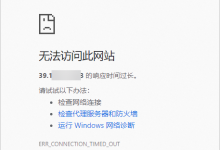

腾讯云性能基准测试如下: 【1.5B模型:内存占用2G左右】 2c4g(S5):生成过程中,CPU占用100% 2c8g(S5):生成过程中,CPU占用100% 4c16g(S2):生成过程中,CPU占用100% 16c64g(SA2):生成过程中,CPU占用30~40%

【7B模型:内存占用7.6G左右】 4c8g(SA2):生成过程中,CPU占用100% 16c64g(SA2):生成过程中,CPU占用50%

此使用帮助适用宝塔面板9.4.0以上的版本(2025年2月6日后发布的滚动修复包,请修复面板后安装DeepSeek-R1)

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册