在ubuntu服务器上部署了deepseek,想要通过windows客户端访问,便使用了AnytingLLM,不但可以使用服务器上AI模型,还可以根据自己准备的数据文档进行“微调”,下面是教程;

如何在服务器上部署本地deepseek可访问:ollama部署本地deepseek,教程详细(ubuntu环境)-CSDN博客

安装AnytingLLM

下载地址:Download AnythingLLM for Desktop

点击下一步

点击浏览修改安装目录,点击安装

点击完成,启动

配置AnytingLLM

输入你自己邮箱进行验证,或点击下方跳过。

工作区的话新建一个文件夹,把路径复制进去。

添加ollama

下面标红的地方是进行设置模型和ollama所在服务器连接的。

点击①,通用设置工作区已经设置了,也可以更改。

别忘了保存,在最下方。

别忘了保存,在最下方。

点击返回,再点击下方小扳手按钮。

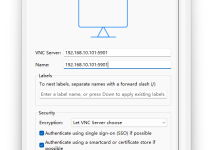

点击①首选项,点击②LLM供应商选择ollama,在③处选择安装ollama的服务器的ip和地址。

因为windows充当客户端,Ubuntu充当服务器,AnythingLLM和ollama不在一台设备上,这时候还要做一些处理。

配置局域网连接

首先打开Ollama的配置文件

sudo gedit /etc/systemd/system/ollama.service

在[Service]下面加上:ollama默认端口是11434;

Environment="OLLAMA_HOST=0.0.0.0:11434"

然后查看防火墙状态:windows和 Ubuntu防火墙都关了就行;

然后更新并重新启动ollama:

sudo systemctl daemon-reload

sudo systemctl enable ollama

sudo systemctl restart ollama

这时候应该就能通过AnythingLLM访问服务器上Ollama了。

构建本地知识库

①点击上传资料;

点击①打开目录上传,点击②选中,点击③移动到工作空间。

红框中就是添加的文档,点击下方save保存。

这样就添加成功了。

这是使用

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册